La gestion d’un site Drupal à forte charge représente un défi technique majeur pour les organisations modernes. Avec l’explosion du trafic numérique et l’évolution constante des attentes utilisateurs, maintenir des performances optimales devient crucial pour la réussite d’un projet web. Un site Drupal bien configuré peut gérer des millions de visiteurs simultanés, mais cette capacité nécessite une architecture minutieusement planifiée et une maintenance rigoureuse. Les enjeux dépassent largement la simple vitesse d’affichage : ils touchent au référencement naturel, à l’expérience utilisateur et à la rentabilité globale du projet.

Architecture serveur haute performance pour drupal

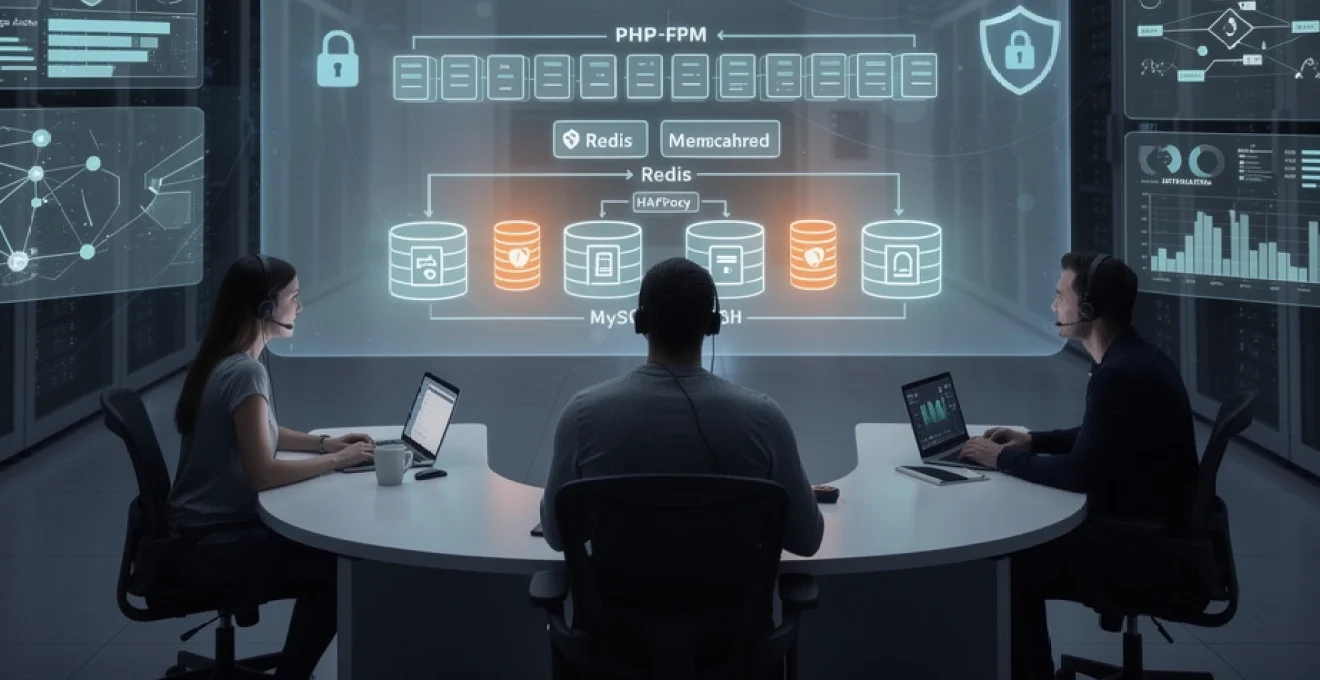

L’architecture serveur constitue la fondation de toute installation Drupal performante. Une approche stratifiée s’impose, combinant plusieurs technologies complémentaires pour optimiser chaque aspect du traitement des requêtes. Cette architecture doit anticiper les pics de trafic tout en maintenant une consommation de ressources maîtrisée pendant les périodes creuses.

Configuration optimale de apache, nginx et PHP-FPM

Le choix entre Apache et Nginx influence directement les performances de votre site Drupal. Nginx excelle dans la gestion des connexions simultanées grâce à son architecture événementielle, traitant efficacement plus de 10 000 connexions concurrentes avec une empreinte mémoire réduite. Sa configuration pour Drupal nécessite une attention particulière aux règles de réécriture d’URL et à la gestion des fichiers statiques.

La configuration PHP-FPM représente un élément déterminant dans l’équation performance. Le paramétrage des pools de processus doit s’adapter au profil de charge de votre site. Une configuration type prévoit pm.max_children = 50, pm.start_servers = 20 et pm.max_requests = 1000 pour un serveur avec 8 Go de RAM. L’ajustement de ces valeurs selon votre environnement spécifique peut multiplier par trois les performances observées.

Mise en place de redis et memcached pour la mise en cache

Redis et Memcached transforment radicalement les performances Drupal en stockant les données fréquemment consultées en mémoire vive. Redis présente l’avantage de la persistance des données et supporte des structures de données avancées, particulièrement adaptées aux besoins complexes de Drupal. Sa configuration pour un site à forte charge implique généralement une allocation de 2 à 4 Go de mémoire dédiée.

L’intégration avec Drupal s’effectue via le module Redis, qui remplace le système de cache par défaut. Cette substitution améliore les temps de réponse de 40 à 60% selon les études de performance récentes. La configuration optimale inclut la séparation des caches par type : cache pages, cache entités et cache de rendu utilisent des instances Redis distinctes pour maximiser l’efficacité.

Répartition de charge avec HAProxy et varnish

HAProxy orchestre la distribution du trafic entre plusieurs serveurs applicatifs, assurant la disponibilité continue même en cas de défaillance d’un nœud. Sa configuration avancée intègre des algorithmes de répartition intelligents, privilégiant les serveurs les moins chargés tout en maintenant la persistance de session nécessaire à Drupal.

Varnish agit comme un reverse proxy ultra-performant, capable de servir des milliers de pages par seconde depuis son cache mémoire. L’intégration avec Drupal nécessite une configuration VCL personnalisée, tenant compte des spécific

icités de la gestion de sessions et des pages personnalisées. En pratique, vous configurerez des règles pour ne jamais mettre en cache les pages des utilisateurs connectés, les formulaires ou les chemins sensibles comme /user/*. L’utilisation combinée d’HAProxy, Varnish et Drupal permet de servir la majorité du trafic depuis la mémoire, tout en réservant PHP-FPM et la base de données aux requêtes réellement dynamiques.

Optimisation des paramètres MySQL et MariaDB

Pour un site Drupal à forte charge, MySQL ou MariaDB mal configurés deviennent rapidement le principal goulot d’étranglement. La première étape consiste à dimensionner correctement le innodb_buffer_pool_size, qui devrait représenter entre 60 et 70 % de la RAM disponible sur un serveur dédié à la base de données. De même, des paramètres comme innodb_log_file_size, innodb_flush_log_at_trx_commit ou encore query_cache_type (désactivé sur les versions récentes) ont un impact direct sur la latence des requêtes.

Une bonne pratique consiste à utiliser un fichier de configuration séparé pour Drupal, incluant des réglages spécifiques par environnement (préproduction, production, haute charge). Vous pouvez par exemple abaisser max_connections pour éviter la saturation en cas de pic brutal, tout en couplant cela à un pool de connexions côté PHP. L’analogie est simple : au lieu d’ouvrir et fermer la porte de votre boutique à chaque client, vous laissez un portier dédié gérer les entrées sans épuiser vos ressources.

Stratégies de mise en cache avancées pour drupal

Une architecture serveur solide ne suffit pas si la couche applicative Drupal n’exploite pas pleinement son système de cache. C’est souvent là que se joue la différence entre un site qui tient la charge et un autre qui s’effondre lors d’une campagne marketing. En combinant intelligemment cache interne, reverse proxy et cache navigateur, vous pouvez réduire de plus de 80 % la charge réelle sur PHP et MySQL.

Configuration du système de cache interne de drupal 9/10

Drupal 9/10 dispose d’un système de cache interne très modulable, structuré autour des bins de cache (cache_render, cache_page, cache_data, etc.). La première étape consiste à s’assurer que tous les caches du cœur sont activés : cache de page interne pour les utilisateurs anonymes, cache dynamique de page et cache de rendu. Dans settings.php, vous pouvez rediriger ces bins vers Redis ou Memcached pour éviter de saturer la base de données.

Pour un site Drupal à forte charge, il est crucial de définir des durées de vie adaptées (max-age) en fonction du type de contenu. Une page éditoriale peu modifiée pourra être mise en cache plusieurs heures, là où une page de stock produit ne le sera que quelques minutes. Vous contrôlez ce comportement via les paramètres de performance et, pour les développeurs, via les métadonnées #cache dans les tableaux de rendu.

Implémentation de BigPipe et dynamic page cache

BigPipe et Dynamic Page Cache sont deux piliers pour réduire le Time To First Byte et améliorer la sensation de rapidité. Dynamic Page Cache met en cache les parties non personnalisées de la page, y compris pour les utilisateurs connectés, tandis que BigPipe envoie le HTML de base immédiatement, puis injecte les zones dynamiques au fur et à mesure de leur génération. En d’autres termes, l’utilisateur voit rapidement la structure de la page, même si certains blocs se chargent en différé.

Pour activer BigPipe, il vous suffit d’activer le module du même nom et de vérifier que votre thème prend en charge le rendu fragmenté. Cette approche est particulièrement efficace pour les tableaux de bord, les espaces membres ou les back-offices très sollicités. Avez-vous déjà remarqué qu’une page semble “rapide” dès lors qu’elle affiche quelque chose, même si tout n’est pas encore interactif ? C’est précisément l’effet que BigPipe cherche à reproduire côté Drupal.

Gestion des tags de cache et invalidation intelligente

Les cache tags sont l’un des atouts majeurs de Drupal pour les sites à forte charge. Au lieu de vider massivement le cache au moindre changement, vous ciblez uniquement les fragments impactés grâce à des tags comme node:123, taxonomy_term:5 ou config:system.site. Lorsqu’un contenu est mis à jour, Drupal invalide les entrées de cache associées à ces tags, laissant le reste intact.

Dans un contexte de fort trafic, cette invalidation granulaire évite les “tempêtes de cache” où tout le monde reconstruit les mêmes pages en même temps. Les développeurs doivent systématiquement définir les tags dans les tableaux de rendu : $build['#cache']['tags'][] = 'node:' . $node->id();. Pensez-y comme à un système d’étiquettes de stockage : plutôt que de vider tout l’entrepôt lorsqu’un produit change, vous ne remplacez que les cartons concernés.

Utilisation de drupal console pour la gestion du cache

Drupal Console, complément moderne à Drush, permet de gérer et diagnostiquer le cache directement en ligne de commande. Des commandes comme drupal cache:rebuild ou drupal cache:tag:invalidate node:123 vous donnent un contrôle précis sans passer par l’interface graphique. C’est particulièrement utile en production, où vous souhaitez limiter les manipulations dans l’admin lors des périodes de forte audience.

Vous pouvez également écrire des scripts d’automatisation pour purger certains caches à intervalles réguliers ou après un déploiement. Pourquoi ne pas intégrer ces commandes dans votre pipeline CI/CD ? Ainsi, chaque mise en production déclenche une invalidation ciblée des tags critiques, sans pour autant provoquer un “cold start” complet du cache Drupal.

Optimisation de la base de données et des requêtes

Même avec un cache agressif, un site Drupal à forte charge finit toujours par solliciter sa base de données. Une optimisation fine de MySQL ou MariaDB, associée à une analyse rigoureuse des requêtes, permet de gagner des millisecondes précieuses sur chaque hit. À grande échelle, ces millisecondes se traduisent en centaines d’heures CPU économisées chaque mois.

Indexation avancée des tables drupal

Les tables standards de Drupal (node_field_data, cache_* , watchdog, etc.) disposent déjà d’index par défaut, mais ils ne suffisent pas toujours pour des cas d’usage complexes. L’analyse des requêtes lentes via le slow query log de MySQL permet d’identifier les colonnes fréquemment utilisées dans les clauses WHERE ou ORDER BY. Vous pourrez alors créer des index composites ciblés, par exemple sur (status, type, created) pour optimiser les listings éditoriaux.

Attention toutefois à ne pas multiplier les index sans réflexion, au risque de dégrader les performances d’INSERT et d’UPDATE. Une bonne approche consiste à tester chaque nouvel index sur un environnement de préproduction, avec un jeu de données réaliste. Là encore, l’analogie de l’entrepôt s’applique : plus vous créez de “plans” pour retrouver un produit, plus il faut de temps pour les tenir à jour.

Optimisation des vues complexes avec views query alter

Les vues Drupal sont souvent responsables des requêtes les plus coûteuses, en particulier lorsqu’elles enchaînent les jointures et filtres dynamiques. Le hook hook_views_query_alter() permet de modifier la requête SQL générée automatiquement, pour par exemple simplifier un JOIN, ajouter une condition statique ou forcer l’utilisation d’un index. Dans certains cas, transformer une vue en requête personnalisée via Views PHP n’est plus recommandé ; mieux vaut utiliser un plugin de handler dédié.

Question à vous poser systématiquement : cette vue doit-elle vraiment être dynamique à chaque requête ? Pour les listes publiques lourdes, activez la mise en cache de la vue (au niveau de l’affichage) sur une durée adaptée, et réduisez le nombre d’arguments contextuels. Vous pouvez également utiliser une vue “pré-calculée” qui s’appuie sur une table de résumé générée par un CRON, idéal pour les tableaux de bord statistiques en contexte de fort trafic.

Mise en place de réplication Master-Slave MySQL

Pour répartir la charge de lecture sur un site Drupal à forte audience, la réplication MySQL Master-Slave reste une solution éprouvée. Le principe : le serveur master gère toutes les écritures (INSERT, UPDATE, DELETE), tandis qu’un ou plusieurs slaves servent les requêtes de lecture. Drupal peut être configuré pour utiliser cette architecture via settings.php et des modules comme mysql_replication ou via une configuration personnalisée.

Dans ce schéma, il est essentiel de bien comprendre la latence de réplication. Si votre site réalise des mises à jour critiques (paiements, commandes), vous devrez forcer certaines requêtes à pointer vers le master pour garantir la cohérence des données. L’analogie avec une bibliothèque est parlante : le master est l’archive officielle, les slaves sont des copies de consultation qui absorbent la majorité des lecteurs sans épuiser la ressource principale.

Utilisation de devel et query monitor pour l’analyse

Les modules Devel et Webprofiler (inclus dans Devel) sont vos meilleurs alliés pour analyser les requêtes générées par Drupal. Ils affichent, pour chaque page, la liste des requêtes SQL exécutées, leur temps d’exécution et leur origine dans le code. Vous identifiez ainsi rapidement les vues problématiques, les modules trop bavards ou les boucles sur-optimistes.

Pour un site en production à forte charge, ces outils doivent être activés uniquement sur un environnement de développement ou sur un sous-domaine protégé. Vous pouvez néanmoins vous inspirer de leurs rapports pour cibler vos efforts d’optimisation. Là où certains développeurs “devinent” les problèmes de performance, vous, vous les mesurerez objectivement.

Configuration de percona toolkit pour le monitoring

Percona Toolkit fournit une série d’outils avancés pour auditer et optimiser vos bases MySQL ou MariaDB. pt-query-digest permet par exemple d’analyser vos logs de requêtes lentes et de générer un rapport détaillé sur les requêtes les plus coûteuses. Vous pouvez programmer son exécution régulière et suivre l’évolution de vos optimisations dans le temps.

Couplé à Drupal, Percona Toolkit devient un véritable radar de performance. Vous identifiez non seulement les requêtes lentes, mais aussi celles qui augmentent en fréquence lorsqu’un nouveau module est activé ou qu’une vue est modifiée. En contexte de haute charge, cette visibilité est indispensable pour anticiper les problèmes avant qu’ils n’affectent vos utilisateurs finaux.

Surveillance et monitoring des performances en temps réel

Un site Drupal à forte charge ne peut se contenter d’un monitoring ponctuel. Il nécessite une surveillance en temps réel pour détecter les anomalies, les pics soudains de trafic ou les dérives de consommation de ressources. L’objectif : passer d’une posture réactive à une posture proactive, où vous anticipez les incidents plutôt que de les subir.

Des solutions comme New Relic, Datadog ou Prometheus/Grafana permettent de suivre en continu les temps de réponse, le taux d’erreurs, la charge CPU et mémoire, ainsi que les performances de la base de données. Intégrées à Drupal via des agents ou des exporters, elles offrent une vision de bout en bout de votre chaîne applicative. Vous pouvez par exemple croiser le temps de génération des pages Drupal avec le taux de cache hit de Varnish pour comprendre où se situent réellement les lenteurs.

Déploiement et maintenance en environnement haute disponibilité

Maintenir un site Drupal à forte charge implique de repenser entièrement vos processus de déploiement et de maintenance. Les mises à jour de sécurité, les déploiements de nouvelles fonctionnalités ou les montées de version ne doivent pas impacter la disponibilité du service. Pour y parvenir, vous mettrez en place des stratégies comme le blue-green deployment ou les canary releases.

Concrètement, cela signifie que vous disposez de deux environnements de production quasi identiques. Vous déployez et testez la nouvelle version sur l’environnement “bleu” pendant que le “vert” continue de servir les utilisateurs, puis vous inversez le trafic via votre load balancer (HAProxy, par exemple). En cas de problème, vous revenez instantanément à la version précédente. Ce type d’approche, combiné à une automatisation forte (CI/CD), est essentiel pour limiter les fenêtres de maintenance sur un site Drupal fortement sollicité.

Sécurisation d’un site drupal sous forte charge

La sécurité d’un site Drupal à forte charge ne se limite pas à appliquer les mises à jour du cœur et des modules. Plus votre site attire de trafic, plus il devient une cible pour les attaques par déni de service, les tentatives d’injection ou les bots malveillants. Il est donc crucial de combiner durcissement applicatif, filtrage réseau et bonnes pratiques DevSecOps.

Au niveau de l’infrastructure, vous mettrez en place un WAF (Web Application Firewall), des règles de rate limiting sur Nginx ou HAProxy, et éventuellement un service de protection DDoS via votre CDN. Côté Drupal, limitez le nombre de modules installés, appliquez systématiquement les mises à jour de sécurité et utilisez des modules comme Security Review ou Paranoia pour détecter les configurations à risque. Enfin, n’oubliez pas que la sécurité et la performance sont intimement liées : une attaque non filtrée peut suffire à saturer vos serveurs, même si votre site est parfaitement optimisé.